「AIは電気を食い過ぎる」——2026年、この問題はシリコンバレーを超えて世界的な政策課題になっている。5大ハイパースケーラーが2026年に合計6,600億ドルを超える設備投資を計画する中、100〜500MWを消費するAI最適化データセンターの電力需要は既存の電力インフラを圧迫している。ガスタービン電源は2028年まで予約が埋まり、電力供給がAI半導体普及のボトルネックになるという前例のない事態が発生している。本記事では、このエネルギー危機がチップ設計・データセンター建設・エンジニアリング実践に与える影響を解説する。

1. AIの電力消費:数字で見る実態

具体的な数字を見てみよう。ChatGPTの1回の問い合わせはGoogle検索の約10倍の電力を消費するとされている。これが数億回/日のスケールになると、その電力消費量は中規模都市の電力需要に相当する。MicrosoftはAzureのAIワークロードのために米国内で新規原子力発電所(スリーマイル島の再稼動)の電力を購入。Googleはデータセンター周辺の太陽光・風力発電への大規模投資を加速している。Amazonも2026年に自社データセンター向けの核融合発電スタートアップへ出資している。

Edge AI and Vision Allianceの2026年半導体レポートが示した通り、AI業界のバイイングコンバセーション(購買判断基準)は「ピーク演算性能」から「FLOPS/W(ワットあたり演算性能)」「レイテンシ/クエリ」「コスト/推論」へと明確にシフトしている。

2. FLOPS/Wが新時代の半導体評価軸に

電力効率革命はチップ設計の根本を変えている。NVIDIAのBlackwellアーキテクチャからVera Rubinへの進化でも、演算密度向上と電力効率改善が最重要設計目標として明示されている。TSMCのN2プロセスが前世代比25〜30%の電力効率向上を実現したことの意義は、ダイサイズ縮小だけでなく「同じ電力でより多くを計算できる」という点にある。

Googleが「Quantum Echoes」で示した量子優位性も、「電力効率」の観点から注目に値する。量子コンピューターが特定タスクで古典コンピューターの13,000倍高速なら、同じ計算を圧倒的に少ない電力で実現できる可能性がある。中長期的には量子×AIの組み合わせがエネルギー問題の一部解決策になるかもしれない。

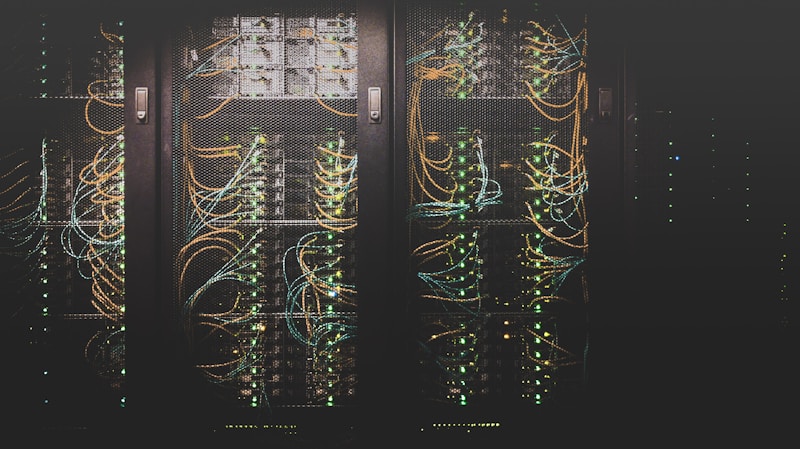

3. データセンター設計の技術革新

電力制約を克服するため、データセンター設計そのものが根本から変わりつつある。

液体冷却(Liquid Cooling)の主流化:従来の空冷では高密度AIチップの発熱を処理できなくなってきた。Direct Liquid Cooling(DLC)・浸漬冷却(Immersion Cooling)が2026年の新設データセンターでは標準装備になりつつある。液体冷却はPUE(電力効率指標)を1.15以下(空冷では1.5〜2.0程度)に下げ、エネルギー効率を大幅に向上させる。

廃熱の再利用:データセンターの廃熱を地域暖房に活用する取り組みがヨーロッパで進んでいる。フィンランドのFacebook・Googleのデータセンターは周辺住宅への暖房供給に廃熱を活用しており、エネルギー効率を実質100%近くまで高めている。

モジュラー型・分散型データセンター:大規模集中型から、電源に近い場所に分散配置するマイクロデータセンターへのシフトも起きている。再エネ発電所に隣接したデータセンター建設が「ストランデッドエネルギー(余剰電力)」の有効利用として注目されている。

4. ソフトウェアレベルの電力効率最適化

電力問題はハードウェアだけでなく、ソフトウェアエンジニアにも影響する。AIモデルの推論効率化(量子化・蒸留・スパースアテンション)はFLOPS/W改善に直結するため、ML エンジニアにとってモデル最適化は「パフォーマンスチューニング」だけでなく「環境負荷低減」という側面を持つようになった。

PyTorchの「torch.compile」やHugging Faceの「Optimum」ライブラリを使ったモデル量子化(INT8/INT4)は、推論速度を2〜4倍向上させながら電力消費を大幅削減できる。llama.cpp・vLLM・TensorRT-LLMなどの高効率推論エンジンも急速に成熟しており、同じモデルをより少ない電力で動かすアーキテクチャが普及している。

5. エンジニアが知っておくべき持続可能なAI設計

「Green AI」「Sustainable AI Engineering」という概念が2026年のエンジニアコミュニティで注目されている。具体的な実践としては、①モデルの不必要な肥大化を避けたコンパクト設計(Phi-3・Gemma等の小型高効率モデルの活用)、②クラウドリージョン選択における再エネ利用率の考慮、③推論バッチングによるGPU稼働率最大化、④不要なAPIコール削減によるエネルギーフットプリント削減——などが挙げられる。

【エンジニアの視点】電力問題はAIエンジニアの新たな責務

AIの電力消費問題は単なるインフラ担当者の課題ではない。モデルを設計・選択・デプロイするエンジニア全員が、電力効率を設計指標の一つとして考える時代になった。「このモデル呼び出しは本当に必要か?」「バッチ推論で代替できないか?」「より小型の量子化モデルで十分ではないか?」——こうした問いを常に持つことが、2026年のAIエンジニアとしての専門性の一部だ。パフォーマンスと持続可能性を両立した「Green AI Engineering」の実践こそが、次世代のエンジニアリング倫理だ。

📚 関連書籍・技術書(楽天で探す)

まとめ:電力効率がAI競争の次のフロンティア

AIの電力問題は制約ではなく、イノベーションのドライバーだ。FLOPS/Wを競うチップ設計競争、液体冷却・廃熱利用のデータセンター革新、量子化・スパース化によるソフトウェア最適化——これらはすべて電力制約から生まれた技術革新だ。エンジニアとして、パフォーマンスだけでなく電力効率・持続可能性を設計思想に組み込むことが、2026年以降のAI時代に生き残る鍵となる。